엔비디아(www.nvidia.co.kr)가 자사의 옴니버스 클라우드 API(Omniverse Cloud API)로 자율 시스템 개발을 가속화한다고 발표했다.

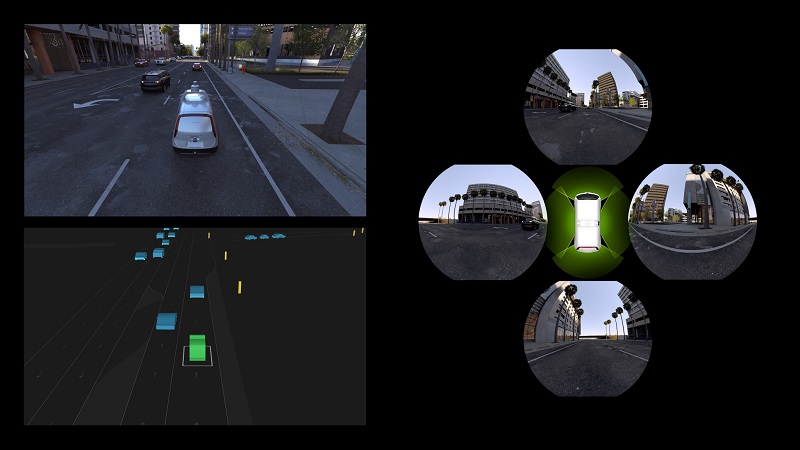

시뮬레이션은 자율성 훈련, 테스트, 배포에 매우 중요하지만 실제와 같은 충실도를 달성하는 것은 매우 어렵다. 이를 위해서는 자율 시스템의 센서와 주변 환경의 물리적 특성과 동작을 정확하게 모델링해야 한다.

이번 주 엔비디아(NVIDIA) 개발자 콘퍼런스 GTC(GPU Technology Conference) 2024에서 발표된 옴니버스 클라우드 API는 대규모의 고충실도 센서 시뮬레이션으로 이러한 과제를 해결하기 위해 설계돼 자율성을 향한 여정을 가속화할 예정이다. 이와 함께 시뮬레이션 툴, 애플리케이션, 센서로 구성된 에코시스템이 완성된다.

옴니버스 클라우드 API는 자율 시스템이 겪게 될 수많은 실제 시나리오를 안전하게 탐색하기 위한 고충실도 센서 시뮬레이션에 대한 중요한 요구사항을 해결한다. 또한, 옴니버스 클라우드 플랫폼은 애플리케이션 개발자에게 다양하고 강력한 오픈USD (OpenUSD), RTX, 생성형 AI 기반 서비스 수준 클라우드 API를 통해 차세대 툴에 상호 운용성과 물리 기반 렌더링을 제공한다.

새로운 수준의 안전성을 위해 필수적인 시뮬레이션

로봇, 자율주행차(AV), 기타 AI 시스템에 대한 수요가 증가함에 따라 개발자는 워크플로를 가속화하고자 한다. 센서 데이터는 이러한 시스템의 인식 기능을 강화해 주변 환경을 이해하고 실시간으로 정보에 입각한 의사결정을 내릴 수 있도록 도와준다.

전통적으로 개발자는 훈련, 테스트, 검증에 실제 데이터를 사용해 왔다. 하지만 이러한 방법은 현실에서 포착할 수 없는 시나리오나 데이터를 다루는 데 한계가 있다. 센서 시뮬레이션은 수많은 '가정' 시나리오와 다양한 환경 조건을 효과적으로 테스트할 수 있는 원활한 방법을 제공한다.

개발자는 옴니버스 클라우드 API를 통해 이미 사용 중인 워크플로를 고충실도 센서 시뮬레이션으로 개선해 풀스택 자율성 개발의 어려움을 해결할 수 있다. 이는 개발 프로세스를 간소화할 뿐만 아니라 자율 장비를 개발하는 거의 모든 규모의 기업의 진입장벽을 낮출 것으로 기대된다.

에코시스템의 이점

옴니버스 클라우드 API는 시뮬레이터, 검증 및 확인(V&V) 툴, 콘텐츠와 센서 개발자로 구성된 광범위한 에코시스템을 완성함으로써 AI 시스템 개발을 위한 범용 환경을 구현한다.

칼라(CARLA), 매스웍스(MathWorks), 마이터(MITRE), 포어텔릭스(Foretellix), 복셀51(Voxel51)과 같은 개발자와 소프트웨어 공급업체는 자율주행차에서 이러한 API가 얼마나 폭넓게 활용되는지 강조한다.

칼라는 10만 명 이상의 개발자가 사용하는 오픈소스 AV 시뮬레이터다. 칼라 사용자는 옴니버스 클라우드 API를 통해 고충실도 센서 시뮬레이션으로 기존 워크플로를 개선할 수 있다.

마이터는 미 연방정부의 자금지원을 받는 R&D 센터를 운영하며 기술의 안전성 향상에 전념하는 비영리 단체이다. 마이터는 자율주행 솔루션 검증을 위해 AV 업계를 위한 디지털 시험장(Digital Proving Ground, DPG)을 구축하고 있다. DPG는 개발자를 위한 핵심 센서 시뮬레이션 기능을 구현하기 위해 옴니버스 API를 사용할 예정이다.

매스웍스와 포어텔릭스는 테스트 시나리오의 작성, 실행, 모니터링, 디버깅을 위한 중요한 시뮬레이션 툴을 제공한다. 이러한 시뮬레이션, 테스트 자동화 툴과 API를 결합하면 AV 개발을 위한 강력한 테스트 환경을 구축할 수 있다.

또한, API를 복셀51의 피프티원(FiftyOne) 플랫폼과 통합해 개발자는 시뮬레이션에서 생성된 실측 데이터를 쉽게 시각화하고 구성하며 훈련과 테스트를 간소화할 수 있다.

선도적인 산업용 센서 솔루션 제공업체인 씨크 AG(SICK)는 센서 개발 프로세스에 이러한 API를 통합해 물리적 프로토타입 수를 줄인다. 또한 설계 수정을 빠르게 반복하며 최종 성능을 검증하기 위해 노력하고 있다. 이렇게 검증된 센서 모델은 최종적으로 자율 시스템 개발자가 애플리케이션에 사용할 수 있다.

또한, 개발자는 라이더 제조업체인 헤사이(Hesai), 이노비즈 테크놀로지스(Innoviz Technologies), 루미나(Luminar), 마이크로비전(MicroVision), 로보센스(Robosense), 세욘드(Seyond)를 비롯해, 시각 센서 공급업체인 옴니비전(OMNIVISION), 온세미(onsemi), 소니 세미컨덕터 솔루션즈(Sony Semiconductor Solutions), 레이더 분야의 콘티넨탈(Continental), 포비아 헬라(FORVIA HELLA), 아르베(Arbe) 등 다양한 제조업체의 센서 모델을 활용할 수 있다.

AI/ML 개발자는 이러한 API를 호출해 자율 시스템을 구동하는 인식 모델을 훈련하고 검증하는 데 중요한 입력인 대규모의 다양한 합성 데이터 세트도 생성할 수 있다.

개발자 역량 강화와 혁신 가속화

엔비디아 옴니버스 클라우드 API는 고충실도 센서 시뮬레이션에 대한 기존의 장벽을 낮춤으로써 개발자가 인프라를 크게 바꾸지 않고도 복잡한 AI 문제를 해결할 수 있도록 지원한다.

고급 시뮬레이션 툴 사용의 대중화는 혁신을 가속화해 개발자가 최신 기술 발전에 빠르게 적응하고 테스트와 개발 프로세스에 통합할 수 있도록 돕는다.

API: Application Programming Interfaces

AEM(오토모티브일렉트로닉스매거진)

<저작권자 © AEM. 무단전재 및 재배포 금지>